ChatGPT - 这只流畅对话的随机鹦鹉

“ChatGPT是有感情的吗?”,“ChatGPT能够理性思考吗?”,“为什么我们相信ChatGPT的答案?”最后...

“人工智能浸礼派的善意足以拯救我们吗?还是人工智能盗版者会教会人工智能行为不当并继承地球?(或者在“26年开放AI战争”之后,剩下的部分是什么呢?)”

第一和第二个问题的答案相对容易,即“现在还没有,但最终我们会有‘机器人人类’在我们中间出现……”,第三个问题有点更加微妙(我们将在下文深入探讨),至于第四个问题,我们将求助于马克·安德烈森。

我的看法:人类寻找词语来表达概念和想法;但 ChatGPT 只是表达词语,没有任何根据或概念。它只是为您提供“对您的提示的最佳修辞回答”。

“大型语言模型所擅长的是说出答案应该听起来像什么,这与答案应该是什么是不同的” — 罗德尼·布鲁克斯 [这里]

找到话语说出某件事情和通过串联统计上适当的话语说出任何东西是有区别的——这就是ChatGPT与人类之间的区别。

我们既不应拟人化 ChatGPT LLM,也不应被它的语言复杂度和举止所迷惑。

首先,ChatGPT与一只(普通的)鹦鹉比较!尽管这只是玩笑话,但其中确实有一些真相!

我们是随机鹦鹉吗?

山姆·奥特曼(OpanAI的首席执行官)绝对这样认为!(多明戈斯教授也有一个幽默的反驳)

但是(通常情况下!)我们不会毫无理由地把单词串起来 - 我们进行推理,然后寻找合适的词语来表达那个概念!

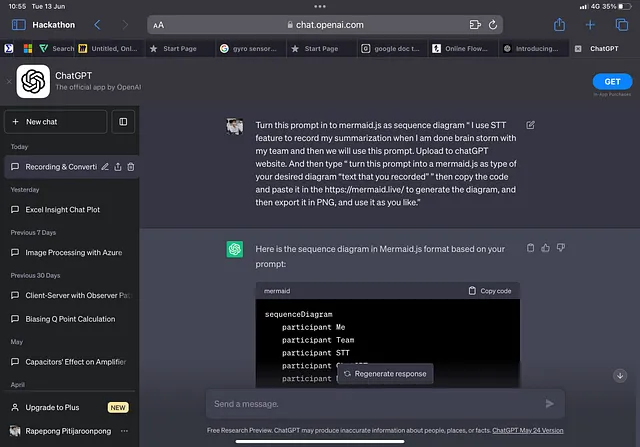

你可能会问什么是随机鹦鹉。Matei Zaharia在他的edX课程LLM101x中有一个有趣的例子:

如果我们让ChatGPT填入“鳄梨是___”这个词,它会说“绿色”,而不是“蓝色”。

这不是因为它知道什么是鳄梨;它的答案是基于训练数据标记,其中“绿色”比任何其他单词具有更高的统计概率(因为它知道具有相似意义的单词通常倾向于出现在类似的上下文中);“鳄梨”和“绿色”具有概率分布上下文,但“鳄梨”和“蓝色”则没有。

就此而言,ChatGPT甚至不知道“绿色”是一种颜色——对于ChatGPT来说,“绿色”只是一个(语境中的)记号。

简而言之,它是从具有随机概率分布的最佳情况重复出发,而不是依赖于任何世俗语义理解或推理。

实际上,ChatGPT 只看得懂数字(作为它的内部表示)——但没关系,因为我们不知道我们的大脑有什么样的内部表示!即使我们感知单词、图像和颜色,它们并不一定是真实世界中的存在形式!是不是很吓人!!

雷·库兹韦尔表示我们将通过逆向工程大脑来解决人工智能,但更有可能的是,我们将通过解决人工智能来逆向工程大脑。——多明戈斯

回到随机行为...

不幸的是,正如山姆·奥特曼所说,我们也以类似的方式学习语法 - 当然,我们不需要数百万个样本和数十亿美元进行训练!一旦我们理解哪个词与其他词搭配使用,我们就这样使用它们 - 或许我们的大脑中有一个随机引擎,或者可能有数以百万计的小型统计引擎!

如果你想知道,鹦鹉并不是随机的 - 我们也不是(除非鹦鹉在 Twitter 上替代了 Sam Altman ;o))。阅读推文 [Here]

语言理解和意识——ChatGPT是一只能说会道的随机鹦鹉吗?

正如Pedro Domingos教授所说:“ChatGPT买家当心——从技术上讲,语言模型是一种将噪音呈现为信号的设备(例如,使语音识别器的输出显得连贯,而不管实际上说了什么)。”

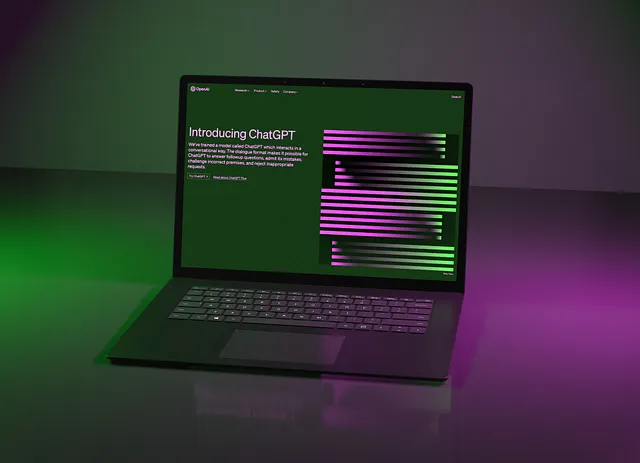

杰弗瑞·摩尔关于这个话题有一个有趣的博客(《理解ChatGPT:修辞的胜利》)。非常有见地而且简明扼要。

摩尔将ChatGPT描述为随机鹦鹉:“ChatGPT完全基于形式而非内容运作。通过处理其语料库的全部,它可以生成与输入提示最相关的最可能的单词序列”。

- 我们需要停止把ChatGPT视为人工智能。它创造了智能的幻象,但它没有语义组件。

- ChatGPT是传递智慧的众人智慧的工具,但它本身没有智慧。

- 它仅基于形式属性构建回复,它是为修辞选择的,而不是逻辑!!

- 它传达了最佳的修辞回答,而非最专业的回答。它是最流行的,而非最深刻的。简而言之,它有极佳的平易近人的方式,这也是我们感到舒适地交流的原因。

请注意强调良好的医患关系-这是其旨在在修辞上具有诱人性的副产品!

“大型语言模型就像高中时期那些约会王般能言善辩。它们已经极为擅长于生成看上去正确的文本。” —— Bertrand Meyer [这里]

ChatGPT 在哪里相关?

杰弗里·摩尔(Geoffrey Moore)对于何时使用ChatGPT以及何时不去接触它有答案。

- “它是最有耐心的老师,也极其博学。它可以彻底改革技术支持、患者护理、索赔处理、社会服务、语言学习以及众多其他学科。”

- 但是,“无论哪里都存在歧义的情况,需要判断的情况,或者涉及道德价值观的情况,人们不能指望ChatGPT成为最终仲裁者”。

- 那并不是它的设计目的。它可以用作输入,但不能信赖其作为最终输出。

- 说得好!!

简而言之,ChatGPT是什么?

让我引用 Bertrand Meyer 结束这篇博客:“一个自信的研究生,聪明而广泛阅读,也很有礼貌,善于道歉,但彻头彻尾的懒散和不可靠!”

“它信心十足地给出了答案,我有点相信它。但有一半的时间,它完全是错的。” — 罗德尼·布鲁克斯 [这里]

ChatGPT 的 Emergent 行为怎么样?

马克·安德森有一篇详细的博客——他双方都有观点,但得出的结论是“人工智能将会是让我们关心的一切变得更好的方法”。

AI图像生成器Midjourney因其新兴的行为而闻名,能够出色地生成图片 - 这些图片之所以有趣,正是因为它们非常不像人类!

生成式人工智能的创新方面很有前途,但我们有几种方式去实现这一点。另一方面,突现的行为可能会使它们变得(可能)危险...

Gizmodo继续说:“正如布鲁克的实验所证明的,仅依靠人工智能生成有吸引力的材料是愚蠢的行为。人工智能实际上非常愚蠢,因为它只能重新打包已经存在的想法,仅使用它来创建内容是一个极为可笑的想法。”

AI(人工智能)尚不能自我推演,但是……仍存希望……不过,这种希望会维持多久呢?

最后,纽约时报可能会有一些这种情况会走向糟糕的方式!这是安德里森博客的完美结尾。

对于那些来得晚的人...

我的一些早期博客关于ChatGPT和生成式AI [这里] & [这里]