Google的Gemini 1.5 Flash-8B:市场上最快最实惠的人工智能模型

Google的最新型号Gemini 1.5 Flash-8B,是目前市场上最快最便宜的。像谷歌过去几个月发布的其他型号一样,8B在基础Flash型号的基础上进行了一些关键改进。这些改进包括降低价格、提高速度和增加速率限制。通过进行这些改变,很明显谷歌计划占据最实惠型号的最顶尖地位。

什么让Gemini 1.5 Flash-8B 与众不同?

谷歌团队对他们的轻量级模型进行了相当多的改变。在他们的博客文章中,他们解释说这些变化是由于“开发者的反馈和对可能性的极限测试”所造成的。这是一个大胆的说法,因此让我们来探讨一下都有哪些改变。

价格下降

令人难以置信的是,随着Flash-8B的发布,Flash的价格已经降低了一半。这种50%的成本降低意味着,现在100万个输入令牌只需0.0375美元,而100万个输出令牌对于大型提示只需0.15美元。

虽然听起来很不错,但我没有直接将其与行业中其他可选方案进行比较,无法真正意识到这种型号的廉价。

较低的延迟

当Gemini 1.5闪存发布时,谷歌解释说它是高性能Gemini 1.5 Pro型号的快速、便宜的替代品。这款新的实验性闪存型号将通过提高模型的速度来扩展这个想法。现在,无论是在AI工作室中进行实验,还是使用Gemini API进行开发,您都会发现更流畅的体验。

我们可以通过人工分析创建的速度比较来真正看到这个模型的速度有多么惊人。他们的数据显示Flash比下一个最佳模型(GPT-4o)快40%。显然,速度是人工智能产品的重要部分。通过利用8B,开发人员可以确保用户会体验到明显更短的响应时间。

增加的速率限制

这个模型的最终主要改进是速率限制。与Flash相比,速率限制翻了倍!鉴于Flash适用于较小、更快的任务,增加的速率限制确保开发人员和用户不受请求数量的限制。新的速率限制是每分钟4,000个请求。

我如何访问Flash-8B?

目前,这款新的 Gemini 模型可以在 Google AI Studio 和 Gemini API 中使用。我建议在过渡到 API 之前,通过 AI Studio 免费试用一下。

Flash-8B与其他双子座模型相比如何?

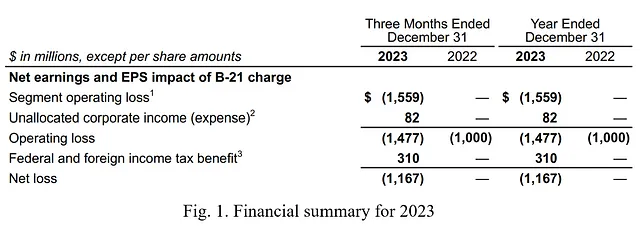

当比较Flash或Flash-8B与其他双子座模型时,重要的是要记住这个模型旨在成为类似Gemini 1.5 Pro这样的强力设备的更便宜和更快的替代品。话虽如此,最新的Flash模型在考虑常见基准评估时仍表现良好。下面的图片显示了不同Gemini模型的比较以及Flash-8B在整体等级中的位置。值得注意的是,这个新模型在只有四个基准评估中表现优于基础Flash模型。然而,在大多数其他评估中只有最小的降低。