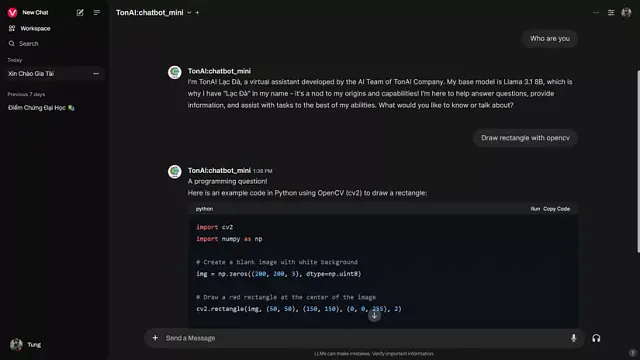

ChatGPT 4:一把双刃剑

人工智能的步伐最近相当令人惊叹,OpenAI的ChatGPT 4也不例外。这个高度先进的语言模型通过提供在问题解决、创造力和推理方面尚未见过的能力,重新定义了对话型人工智能的极限。它生成人类质量的文字的能力适用于从客户服务到创作的各个方面。

混淆之谜

然而,尽管ChatGPT 4取得了令人瞩目的成就,但它远非完美。这款软件的首要缺陷是其倾向于混淆视听,这实际上意味着编造信息,通常还能相当令人信服。在随意对话中这可能有些好玩,但在准确性绝对至关重要的情境中,这可能会非常危险。

错误信息:

误导信息的可能性令人担忧,特别是涉及教育、研究和新闻领域。有人怀疑,如果将ChatGPT 4的虚构事实当作真实,可能会导致广泛的误解、错误甚至危害。一个依赖该模型进行研究的学生可能会提交一篇存在错误的论文。

减轻风险

鉴于ChatGPT 4的强大功能,假设采用负责任的方法来限制风险是很重要的。一些做到这一点的策略包括事实核查、人工监督、对上下文的意识以及不断提高的能力。

事实核查:

这意味着模型提供的信息是经过可靠来源验证的。

人工监督有助于平衡人工智能部分与人类判断和专业知识,以消除偏见和不准确性。

上下文感知:

应该牢记模型使用的案例和限制。

不断改进:

需要持续进行研究和开发以解决混淆问题和其他限制。AI的未来

ChatGPT 4 是一项成就,但我们不要忘记它仍然是一个正在进行中的工作。随着人工智能技术的不断发展,人们应该期望能够处理诸如混淆等问题的改进。了解挑战并负责地使用人工智能,才能释放其为社会利益的全部潜力。

然而,ChatGPT 4是人工智能的一个巨大飞跃,需要谨慎对待。能够进行虚构表明人类的概述和批判性思维确实非常重要。对其限制的认识和保证负责任的使用意味着以降低风险的方式利用其力量。人工智能的未来是光明的;实际上,ChatGPT 4证明了未来可能的可能性。