ChatGPT 如何运作?- 第一部分

这篇文章提供了ChatGPT的明确概述,介绍了其核心概念和技术,同时探讨了其局限性和改进空间。

所以,你听说过ChatGPT,甚至可能使用过它,但是你是否想知道它背后发生了什么呢?让我们用一种易于理解的方式来分解它!

名字的含义是什么?理解GPT

GPT代表生成预训练变换器——但这究竟意味着什么呢?让我们逐字解释一下这个词:

- 生成式:GPT不仅仅是一个复制粘贴机器;它实际上可以生成新的文字。想象一下,它就像是一个超级智能的写作助手,可以起草从推特到完整论文的任何内容。

- 已预训练:在GPT能够创建文本之前,它会经历一个学习阶段,在这个阶段中,它会消化大量的文本数据。例如:一个厨师在创造自己的食谱之前品尝了成千上万道菜肴。在这个预训练之后,它可以被调整(微调)用于特定任务,比如回答问题或聊天。

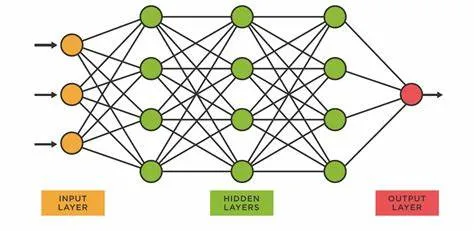

- 变形金刚:GPT 使用一种称为变形金刚的模型,基本上是一种高级神经网络 — 一种模拟我们大脑工作方式的计算机系统。由于自我关注,变形金刚非常擅长理解对话中的上下文。

什么是自注意力?自注意力是在机器学习模型中使用的一种机制,特别是在变压器中,帮助模型在预测时关注输入数据的不同部分。例如,在语言处理中,当一个模型阅读一句话时,自注意力使其考虑句子中所有单词之间的关系。

这样可以让模型找出句子中哪些词更重要,帮助它更好地把握上下文。

The cat sat on the mat because it was tired.

所以,GPT就像一位超级智能的语言伙伴,它从大量的文本中学习,然后利用这些知识生成在相应语境下有意义的回应。

ChatGPT的核心:大型语言模型(LLMs)

在ChatGPT的核心是一个叫做大型语言模型(LLM)的东西。

但LLM到底是什么呢?它是一个经过大量文字训练的神经网络。这种训练使得ChatGPT能够理解并生成类似人类的文字。然而,需要注意的是,虽然它在各种互联网文本上进行了训练,但它实际上并不了解特定的文件或具有个人经验。可以把它想象成一个博学的朋友,他吸收了广泛的知识,但无法回忆任何一本书的具体细节。

例如:如果您问ChatGPT,“在《哈利·波特与魔法石》的第七章中到底发生了什么?”它将无法引用文本或逐字描述场景。但是,它可以谈论书的整体情节、角色和主题,表明它已经广泛学习,没有记住具体细节。

根据普通知识生成相关信息的能力是使LLMs如此多才多艺的原因。

ChatGPT如何产生回应?

当您与ChatGPT互动时,它并不像人类那样“理解”文本。相反,它根据训练中学习到的模式来预测句子中的下一个单词-有点像一个猜词游戏。

过程:

- 在输入框里输入一个句子或问题。

- 令牌化:输入被分解为令牌(文本的较小块)。

- 处理中:模型处理这些令牌,根据学习到的模式预测出最有可能的下一个令牌。

- 输出:然后将预测的标记缝合在一起,形成可读的文本。

如果你输入一个填空句子,模型会根据它在训练过程中学到的模式来预测最合适的词语。它并不能真正理解上下文或含义;它只是根据输入生成看似最可能的回复。

令牌:构建基块

在ChatGPT中,输入和输出是由称为令牌的东西管理的。令牌是单词或部分单词的数值表示。

例如:拿单词“难以置信”来说。 模型可能会将其分解为“难以置信”,“相信”和“能够”,这样就更容易理解,即使以前从未见过整个单词。

为什么要将文字转换为数字呢?数字对计算机和模型的处理比文本更容易。

自然语言处理(NLP)

在其核心,ChatGPT 是自然语言处理(NLP)的产品。

NLP 是人工智能领域,专注于通过自然语言交互的计算机和人类之间的交互。NLP 涵盖了诸如文本生成、情感分析和翻译等任务。

ChatGPT利用自然语言处理技术来理解和自然地回应文本。

请求ChatGPT总结一个段落,并使用NLP提取主要要点,为您提供简洁的摘要。

限制与挑战

虽然ChatGPT令人印象深刻,但它并非没有缺陷。让我们来讨论一下:

- 毒性和偏见:由于ChatGPT是在大量的互联网文本上进行训练的,因此它有时可能会生成有毒或具有偏见的内容。例如:如果你问,“男孩在数学方面比女孩更擅长吗?”它可能会以反映陈见的方式回答,尽管这个想法并不正确。它可能会无意中产生一种反映在其训练数据中发现的偏见观点的回应。

- 幻觉:有时,ChatGPT 可能会“产生幻觉”,生成不准确或毫无意义的信息。如果你问它关于虚构事件,它可能会自信地产生细节,好像它们是真实的。例如:询问它关于“火星和木星之间的战争”,它可能会创造一个完整的背景故事,描述一个从未发生过的冲突!

- 细微差异和背景:ChatGPT在理解细微差异(意义上的小差异或变化)和背景方面可能会遇到困难。如果你使用讽刺或间接暗示某事,它可能会字面上理解你的话。例如:如果你生气地问“你能递盐吗?”,它可能只会认为你想要盐,而忽略了背后的情感。

接下来是什么?

在下一部分中,我们将进一步探讨ChatGPT如何解决模型的这些局限性,同时讨论改善安全性和上下文理解的持续努力。

要查看更多类似的科技内容,请关注我的Medium页面。也可以在LinkedIn上与我联系。