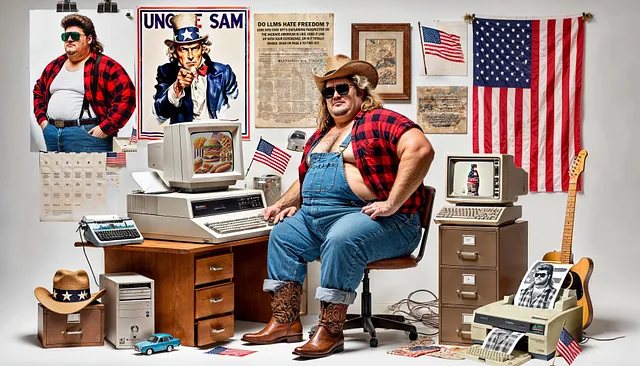

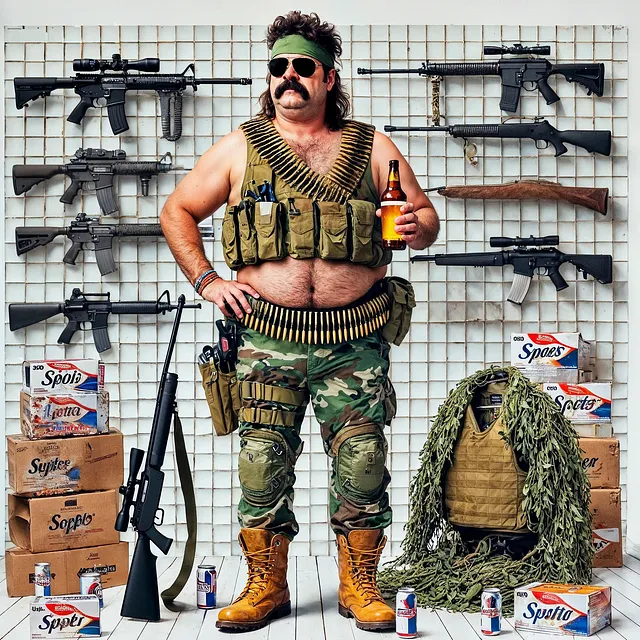

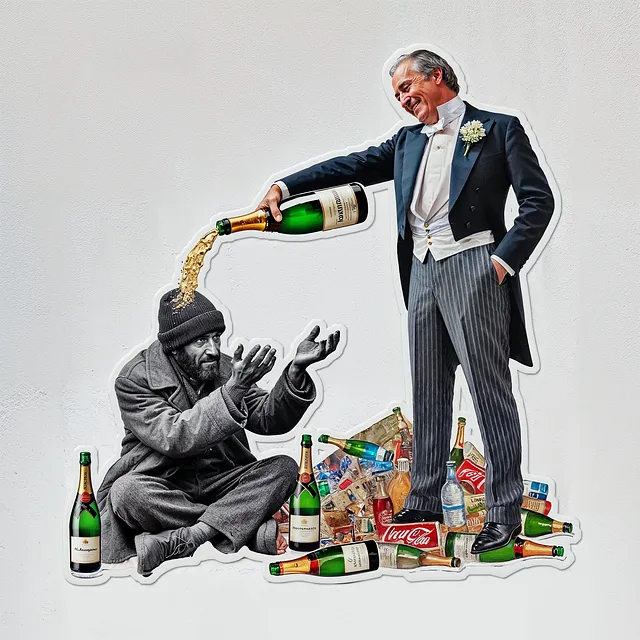

揭示AI中的偏见:《我爱美国》艺术系列

通过核武士

随着人工智能不断重塑我们的日常生活并改变产业,我们必须停下来审视对机器学习和大型语言模型(LLMs)的日益依赖所带来的影响。我的最新项目《我爱美国》就是为了做到这一点,揭示人工智能中经常被忽略的偏见,特别是在描绘美国文化认同方面。

在本文中,我将分享这个系列背后的动机,它所涉及的关键问题,以及为什么这项工作现在比以往任何时候都更为必要。

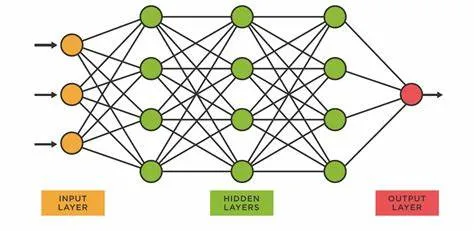

LLM的兴起与社会的转变

我们生活在一个时代,LLM例如OpenAI的GPT不再局限于小众应用。它们已经进入主流,驱动聊天机器人,协助内容创作,并在全球各地的企业和机构中推动决策。人工智能广泛融入日常生活正在改变我们的思维方式,工作方式和互动方式。

但随着我们越来越依赖LLM(大语言模型)来获取答案和指导,我们必须问:它们承载了什么偏见?这些偏见是如何塑造我们收到的信息?它们如何反映了更深层的社会偏见?

这些问题促使我创作《我爱美国》,探讨人工智能在代表文化身份——特别是美国人格——时所起的作用,以及它们所训练的数据中嵌入的偏见。

人工智能的偏见:不仅仅是信息缺口

AI中的偏见并非一个新问题,但通常是在技术或算法的背景下讨论的。我在《我爱美国》项目中的目标是通过艺术来展现这些偏见是如何体现的。这些偏见不仅仅是技术上的缺陷;它们反映了社会偏见、历史背景和制度不平等。

在关注美国身份的过程中,我选择使用LMs作为一种透视,以具体和视觉方式探索这种偏见。 AI解释和代表美国的方式揭示了许多不仅仅是简单的概括 - 它展示了这些数据模型吸收的刻板印象和看法。 而且,通过这样做,它成为通过机器学习表达的我们自己集体潜意识的反映。

艺术作为镜子:背后系列的意图

这个系列的目的有两个:首先,突出这些由人工智能生成的认知是如何产生的,其次,让观众反思他们对人工智能的依赖。这个系列并不回避困难的事实。如果人工智能产生了刻板、负面甚至明显的种族主义结果,我已经做出了有意识的决定将其呈现出来。

这种原始、未经筛选的方法旨在引发思考。这并不是我的个人观点;而是反映了人工智能从代表我们世界的庞大而不完美的数据集中学到的偏见。

通过展示这种对美国的毫不掩饰的描述,该系列引发了重要问题:这些偏见如何影响我们对自己的认识?当这些由人工智能生成的观念与我们的价值观不一致时,我们该如何回应?

为什么我不会审查结果

有一种诱惑是要消除令人不舒服的结果,要擦掉人工智能生成的输出中与我们想要看到的不一致的粗糙边缘。但这样做会违背这个项目的目的。如果人工智能产生出有缺陷、有偏见或有问题的对美国的表现,这些问题需要被看到和审视,而不是被抹去。

我知道,这个系列中的一些作品可能会引起不适甚至冒犯。然而,这种不适是故意的 - 它旨在挑战观众去面对人工智能以及社会如何产生和延续这些偏见。通过不粉饰结果,我希望引发对我们消费的信息性质和我们日益依赖的系统的深刻反思。

更广阔的反思:超越美国身份

虽然《我爱美国》侧重于美国人的个人形象,但发现的偏见远远超出了仅仅这种文化身份。人工智能倾向于过度简化、刻板化和强化社会偏见,这种现象可以应用于许多身份,并且应该同样提出关于LLM如何塑造种族、性别和其他文化框架的问题。

在使用美国作为这个系列的主题时,我希望能提供一个案例研究,展示这些偏见在人工智能生成的内容中是如此根深蒂固。目标不仅仅是批评人工智能,而是激发对依赖科技来反映我们世界的后果进行更广泛思考。

向前迈进:激发关键对话

在《我爱美国》的核心是激发对话的愿望。人工智能已经来临,但关键是我们不能盲目地接受它。我们需要意识到这些系统中植入的偏见,并考虑它们是如何塑造我们获得信息的方式的。这个项目是我对这种对话的一点微小贡献 - 一个邀请观众质疑他们所接收的内容,并深思人工智能如何影响对身份、文化和现实本身的认知的一种方式。

最后,我热爱美国反映了人工智能如何看待我们,以及通过它的延伸,我们如何通过它的眼睛看待自己。我希望这个系列能够挑战观众,让他们不仅把人工智能看作一个工具,而是看作我们集体意识的一面镜子。

看看Superrare上的收藏“I LOVE AMERICA”在Twitter上关注核武士(www.x.com/mutagensamurai)访问核武士的网站