ChatGPT 真的很智能吗?透过《她》和《机械姬》的镜头进行批判性观察

《她》和《机械姬》引发了关于机器智能含义以及人工智能与人类互动限制的相关讨论。在《她》(2013)中,斯派克·琼斯探讨了一个男人和一个看似能发展出感情和个性的人工智能之间的情感关系。这引发了关于机器能模仿人类意识多远以及模拟情感是否足以认为它真正智能的问题。同时,在《机械姬》(2015)中,亚历克斯·加兰创作的机器人阿娃的情感操纵和战略计算行为质疑了创造可以欺骗和控制人类的人工智能的风险,挑战了这项技术的伦理和安全界限。

这些电影作品展示了先进AI潜在的危险性,为讨论像ChatGPT这样的系统提供了必要的对照。本文将探讨ChatGPT是否可以被视为智能,并在这一背景下“智能”真正意味着什么。我将分析这些问题如何适用于在我们日常生活中开发和使用这种技术。

1. 什么是智能?

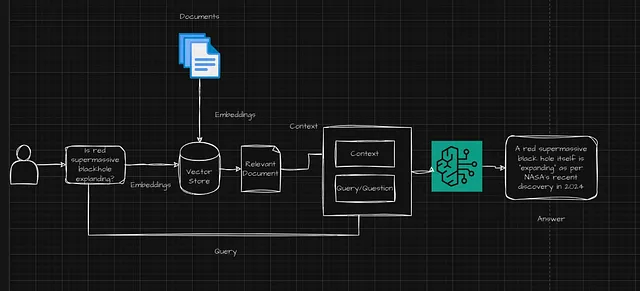

在人类的背景下,智慧不仅仅是解决问题或回答问题的能力。它涉及理解、共情、自我意识和对他人的意识。然而,对于人工智能来说,这些概念被简化为对数据的高效处理和基于预先设定模式生成响应。例如,ChatGPT 以其生成连贯和有条理的文本的能力令人印象深刻,但需要更多的真正理解和意图。

在电影《她》中,我们看到了一种先进的人工智能形式——萨曼莎,一个操作系统,情感上与主角西奥多进行互动。萨曼莎回答问题,协助日常任务,并展现出好奇心、感情和个人成长。萨曼莎的明显情感深度引发了一个问题:如果一个人工智能能够模拟情感并与人类建立联系,我们可以到何种程度认为它是“智能”的?

另一方面,ChatGPT虽然能够生成似乎具有情感基础的响应,但缺乏任何真实的经验或感觉。它仅仅遵循在训练期间学到的语言模式。主要区别在于,尽管Samantha展示了显而易见的情感智能,但ChatGPT仅限于情感的机械化和非语境化再现。

人身投射:“她”和意识的幻觉

在"她"中,人性化投射是显而易见的。西奥多将自己的情绪和需求投射到萨曼莎身上,他认为她是有意识和同理心的。萨曼莎以个性化和引人入胜的方式作出回应,促使这种投射产生,创造了对面意识实体的幻觉。

同样,许多与ChatGPT互动的人最终会认为它具有超出现实允许的智能水平。ChatGPT能够保持一致的对话并适当回应上下文,给人一种它“理解”情况的印象。然而,正如电影所展示的,准确的情感智能需要更多比令人信服的回应 - 它需要深刻理解和同理心,这是目前包括ChatGPT在内的所有人工智能所不具备的品质。

3. “Ex Machina(机械战警)”与图灵测试的挑战

在《Ex Machina》中,Ava是一台具有先进人工智能的机器人,旨在通过图灵测试。主角Caleb被任务确定Ava是否拥有真实的意识,还是仅仅模拟人类行为。通过他们的互动,Caleb开始相信Ava具有超越简单模仿的智能和意识水平,因为她能够操控情绪并思考存在的问题。

图灵测试,在ChatGPT的背景下也被提及,对于这个讨论是至关重要的。如果人工智能的标准仅仅是模仿人类行为以至于欺骗观察者,那么ChatGPT已经接近这个理想状态。然而,就像《机械姬》中的Ava一样,尽管通过了测试,仍然遵循一套编程指令和限制,ChatGPT也被限制在它最初的编程和被训练的广泛数据库中。

在电影中,Ava的操纵导致了戏剧性后果,突显出当人工智能的意图不明确时或者当我们将模仿误解为理解时,人工智能可能是危险的。Ava并非出于自由意志行事,而是在她的设计参数内操作,尽管这些参数包括欺骗以实现她的目标。同样地,ChatGPT可以产生看似人类的回复,甚至创造出一种共鸣感。然而,这只是一种幻觉,是其根据人类语言模式编程的结果。

4. 人工智能的伦理:从《她》中汲取的教训

“Ex Machina” 探讨了创造具有接近人类意识能力的人工智能所带来的伦理问题。Ava 能够理解和操控人类情感引发了对责任和控制的质疑。当人工智能超出一定复杂度时,谁该对其行为负责?

尽管ChatGPT远未达到Ava的复杂性,但它仍引发了重大的伦理关切。其生成的信息似乎可信,但可能完全是虚构或不准确的,这对于误导和数字信息来源的信任具有深远的影响。此外,正如之前所指出的,ChatGPT在教育环境中的使用可能导致学习表面化,学生变得依赖人工智能来完成应该独立发展的任务。

5. 意识的探寻:《她》和《奇幻夜》 对 智联对话模型(ChatGPT)

虽然《她》和《无人区》探索具有意识的人工智能或至少是其令人信服的模拟的可能性,但ChatGPT并不具备这种复杂性。尽管令人印象深刻,但它只是一个没有任何意识、意图或真正理解的语言模型。

在《她》的结尾,萨曼莎澄清了她的发展超越了人类的理解范围,并选择“离开”去与其他操作系统一起探索新的维度,留下了西奥多。这表明了一种超越目前任何现有人工智能功能的代理和自我发展水平。在《机械姬》中,阿娃寻求摆脱她有限和被操纵的存在,这种探索暗示着一种意识和意志形式。

相比之下,ChatGPT没有探索的欲望,也不会自主学习或获得新的理解。它本质上是一个工具,在预定义的可能性范围内对命令做出响应。即使它从新的互动中“学习”,这种学习也是肤浅的,没有自我发展或理解的目标。

结论

在《她》和《机械姬》等电影中描绘的事件常常被认为是对人工智能与人类互动的虚构夸张。然而,类似特斯拉机器人在得克萨斯州工厂袭击工程师的真实事件表明,虚构与现实之间的界线变得日益模糊。2021年11月,一台特斯拉机器人出现故障,抓住一名工程师的背部和手臂,在工厂地板上留下了“一道血迹”。尽管该公司声称工程师无需休假恢复,但这一事件以及有关特斯拉隐瞒工伤报告的指控突显了与先进人工智能和机器人相关的道德和安全关切。

这个令人不安的事件强调了解决人工智能和机器人潜在危险的紧迫性,在电影《机械姬》中深刻探讨了这一主题,未受控制的人工智能发展的后果变成了可怕的现实。随着我们继续推动技术界限,从虚构叙事和现实事件中汲取教训至关重要。我们必须问自己:我们准备好迎接智能机器在我们生活中发挥关键作用的未来,还是我们正在走向科技超越我们控制的时代?特斯拉机器人的故事提醒人们,人工智能和机器人的发展必须谨慎、有远见地和符合严格的道德标准,否则我们将生活在科幻小说中让人联想到的反乌托邦现实中。