我们是否应该适度使用人工智能?(1/?)

“等一下,我问问ChatGPT。”

这是一个在当今听到的越来越多的短语。由OpenAI开发,这个对话代理已逐渐进入我们的日常生活,就像几年前的互联网一样。

今天,ChatGPT(生成预训练变压器)是众多生成人工智能模型之一,因其简单易用并且免费而广受欢迎。

它的用处是不可否认的。无论是弥补灵感不足还是节省时间,这种快速生成想法的方法很少会让人失望,最重要的是让生活变得更轻松。使用生成人工智能也非常简单:您只需要一个提示,就可以生成您想要的信息或图像。在这种情况下,提示这个词来自英语,有几个含义,但关于我们的定义是剑桥词典清楚给出的:“给予人工智能(…)指示,而不是使用计算机语言”。

因此,提示是向AI提供指令以告诉它该做什么,而无需借助计算机代码的语言,使其非常易于访问。即使不知道该词的英文定义,法国用户也可以轻松推断其含义。在法语中,prompt是迅速的同义词;它在Larousse的定义是:“迅速行动”或“没有等待,按时到来,没有延迟和犹豫”。

撰写提示是一种技能,因为它需要以简洁的方式表达自己的意图。提示越精确,获得满意结果的机会就越大。正是这种易用性和可访问性,使得像ChatGPT、Midjourney或Runway这样的AI被推到了最广泛使用的计算机软件之巅,并使它们成为今天数千人工作流程的重要部分。然而,重要的是要保持正确的态度,不要盲目依赖这些机器。

故障可能出在用户身上,如果他们使用模糊的提示,没有提供足够的上下文来查询。例如,由ChatGPT提供的信息将是最具统计学意义的,但不一定是期望的响应。故障也可能出在软件身上,虽然给出的答案看似合适,但可能由虚假信息组成。由于ChatGPT不提供任何来源,用户有责任验证生成的信息,以检查其准确性,避免无意中创造假新闻。

我们选择使用的信息所承担的责任这个概念并不是新的,对生成型AI也并非独特。就像老师告诉学生不要简单地复制粘贴他们在维基百科上找到的内容一样,ChatGPT用户也必须小心不要简单地复制粘贴他们生成的答案。除了生成型AI提供的信息的可靠性之外,还有其他关于使用这些计算机程序需要考虑的问题,为了预防的目的。

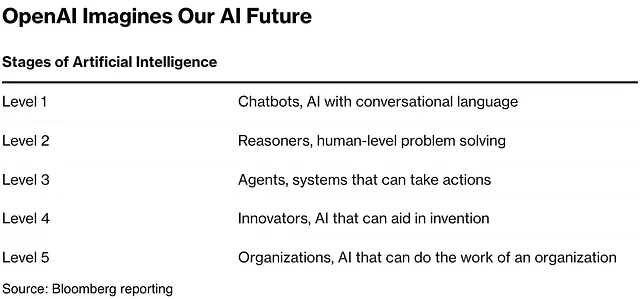

实际上,今天要问的问题是:我们是否应该控制人工智能的使用?