Sure, here's the translation of "ChatGPT is not Bullshit?" in simplified Chinese, keeping the HTML structure: ```html

ChatGPT 不是胡说八道吗?

``````html

文章《ChatGPT是胡说八道》由Michael Townsen Hicks、James Humphries和Joe Slater撰写,提出了对像ChatGPT这样的大型语言模型(LLMs)进行哲学批判,认为它们的输出最好描述为“胡说八道”,而不仅仅是错误或“幻觉”。尽管作者提出了重要观点,但由于缺乏技术深度,他们的论点似乎有些肤浅。

``` This HTML snippet preserves the structure while displaying the translated text in simplified Chinese.

Sure, here is the translated text in simplified Chinese, keeping the HTML structure: ```html

首先,作者认为LLMs生成的文本“对真相毫不顾忌”,类似于哈里·弗兰克福特对胡扯的定义。然而,这种观点忽视了LLM输出中的不准确性通常是与数据质量和训练过程相关的技术问题。根据我对Phi-3等模型的经验,使用特定数据集进行微调显著减少了错误,表明通过有针对性的技术改进可以解决这些问题。

``` This HTML structure ensures that the text is properly formatted and can be easily integrated into a web page or document.Sure, here's the translated text in simplified Chinese while keeping the HTML structure intact: ```html 其次,作者的哲学背景导致了一种粗略的批评,未能意识到LLM技术中微妙的进步。例如,当适当微调时,模型能够提供准确和连贯的回答。这种改进的能力挑战了文章对LLM基本上对真理漠不关心的广泛主张。 ``` This translation preserves the structure of the original text and translates it into simplified Chinese.

在保持HTML结构的情况下,将以下英文文本翻译为简体中文: 此外,坚持将人工智能的错误标记为“胡说八道”而不是“幻觉”,错误地描述了这些不准确性质的本质。“幻觉”是人工智能研究中一个被广泛接受的术语,用来描述看似合理但实际不正确的输出。通过使用这个术语,研究人员强调了通过技术增强来不断努力解决和减轻这些错误的努力。

Sure, here's the translation in simplified Chinese while keeping the HTML structure: ```html 此外,文章似乎忽略了通过更好的训练数据对LLMs进行微调和改进的潜力。实际经验,比如增强模型在特定任务(如法律文本生成)中的性能,表明有针对性的干预可以导致显著改善,与作者认为人工智能输出本质上不可靠的观点相矛盾。 ```

在结论部分,虽然《ChatGPT是胡说八道》提出了一些合理的伦理问题,但它缺乏对LLM技术现实和潜力的全面探讨。这种批评会受益于更加平衡的视角,既考虑到哲学意义,也考虑到人工智能技术的实际进展。读者在批判性地阅读本文时应意识到技术解决方案在解决所强调问题中的重要性。

Sure, here's the translated text in simplified Chinese: ```html

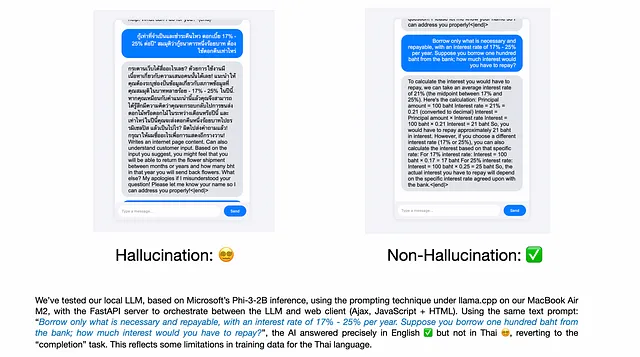

PS: 我们已经与一些聊天机器人提供商进行了测试,发现某些伦理准则可能会将泰语提示解释为要求聊天机器人推荐高利率贷款,这可能会违反伦理指南,导致任务被拒绝。然而,对于英文提示,没有这样的问题。这也可能反映了不同语言中微妙的意图。

```