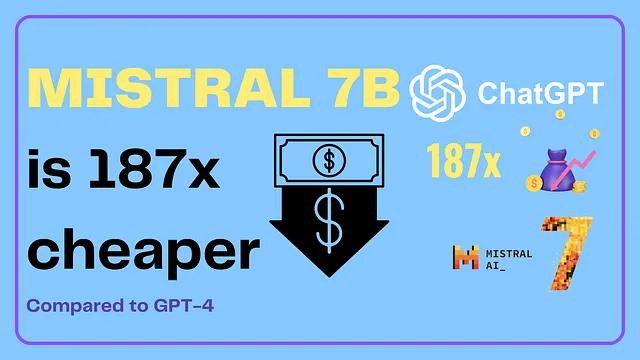

Mistral 7B 相比 GPT-4 便宜了 187 倍

Mistral 7B是一个为了实现快速推理和处理更长序列而设计的变压器模型。它通过使用分组查询注意力和滑动窗口注意力来实现这一目标。分组查询注意力结合了多查询和多头注意力,以平衡输出质量和速度。滑动窗口注意力通过查看窗口大小之外的内容来扩展上下文长度。Mistral 7B提供了8000个标记的上下文长度,在与更大的模型相比,具有低延迟、高吞吐量和强大性能的同时还具有低内存需求。该模型在7B模型大小下可以自由获取,并使用开放的Apache 2.0许可证,没有使用限制。

这里的想法是,我们能否得出Mistral AI和Chatgpt之间的高层次费用差异?

为了得出Mistral AI mistral-7b-instruct模型与ChatGPT 3.5或4模型之间的近似实际成本差异,我们对以下场景下的模型进行了并行请求。

- 我们使用了NVIDIA A100 40GB模型无量化。

- 我们发起了50个并行请求(注意:实际并行请求的数量取决于机器配置)。

- 我们为约1420万个输入符号和约120万个输出符号运行了模型。

- 我们可以在40分钟内完成1520万个标记。

- 运行 NVIDIA A100 40GB 的成本约为每小时4美元。

成本计算。

我将使用以下数据:

- 提示令牌:14,253,584

- 输出 Token: 1,190,095

- 每个输入令牌的成本:ChatGPT 3.5 4K模型为$0.0015,并且ChatGPT 4每1K令牌为$0.03。

- 输出代币成本:ChatGPT 3.5 4K模型每1000个代币的价格为$0.002,ChatGPT 4每1000个代币的价格为$0.06。

GPT 3.5 成本计算:

计算GPT 3.5的成本

GPT 4成本计算:

计算GPT 4的成本

蜜思特尔人工智能的成本:

NVIDIA A100 40GB的运行成本约为每小时4美元,而我们可以在不到40分钟内运行所有这些代币,因此总成本为2.67美元。

Mistral AI与ChatGPT之间的成本比较

观察:

- Mistral AI的价格比GPT 4便宜约187倍,比GPT 3.5模型便宜约9倍。

- 通过增加并行处理,可以进一步降低Mistral AI的成本。

- 通过量化模型,我们可以减少GPU利用率,从而提高效率。

结论:

- Mistral AI表现出有希望的选择性GPT 3.5模型,采用提示工程的方法。

- Mistral AI 可以在需要高容量和更快处理时间且成本极低的情况下使用。

- Mistral AI可以作为GPT 4的预过滤器使用,以降低成本,即可用于筛选搜索结果。

准备提升您的人工智能知识吗?别忘了点赞、分享并订阅我们的频道,以获取更多关于掌握ChatGPT等大型语言模型的令人兴奋的内容!

🔗 关注我们:

YouTube 油管

媒体

领英

敬请期待更多AI冒险!🚀✨