揭开未来的面纱:OpenAI的GPT-4V - 多模态语言模型的飞跃

在人工智能领域,每一个新的黎明都带来了一股新的创新浪潮。今天,我们将深入探讨其中一项具有开创性发展的新技术,它将重新定义我们与人工智能互动的方式。欢迎来到OpenAI的GPT-4V世界,这是一个多模态语言模型,它推动了可能性的界限。

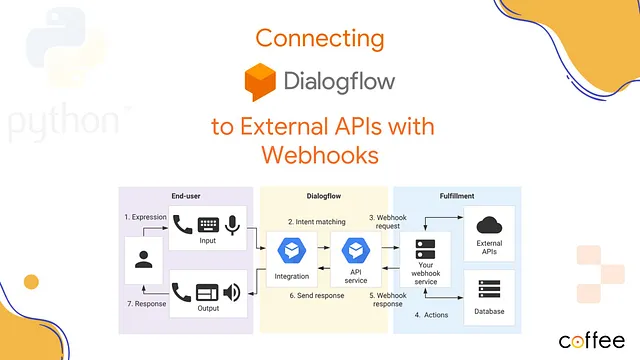

想象一种语言模型,它不仅能理解和生成文本,还能解释图像。听起来像是科幻小说,对吧?但现在不再是了。OpenAI开发了GPT-4V,这是一个多模态语言模型,它结合了图像输入,标志着AI研究和开发的重大飞跃。

GPT-4V 是由 OpenAI 开发的最新功能,旨在分析用户提供的图像输入。这一全新特性拓展了仅限于语言的系统的影响力,使它们能够解决新的任务并为用户提供独特的体验。但是,这是如何运作的?对于 AI 的未来又意味着什么呢?

魔法在于模型能够捕捉图片中的复杂信息,包括从科学出版物中提取的专业形象和带有文字和详细组件的图表。它甚至可以理解最近论文中的高级科学,并批判性地评估对于新颖科学发现的主张。

然而,就像任何技术进步一样,GPT-4V也面临着一系列挑战。这款模型已经经过了严格的安全评估,并针对错误、偏差和幻觉等风险实施了缓解措施。然而,仍存在着一些限制和风险,包括科学熟练度、误导信息和视觉漏洞。

例如,如果图像中有两个紧密相邻的文本组件,模型有时会将它们合并在一起,导致生成无关的术语。它还可能忽视数学符号,无法识别空间位置和颜色映射。

尽管面临这些挑战,OpenAI正在采取措施来解决这些问题,并改进模型的行为、语言支持、图像识别以及对敏感信息的处理。该组织正在投资研究以增强图像识别能力,使其对全球受众更具相关性,并且以更高的精度处理图像上传。

重点关注之一是缓解可能源于刻板印象或贬损输出的代表性伤害。OpenAI已经对大多数敏感特征请求添加了拒绝策略,确保模型不会进行有害或偏见行为。

GPT-4V的发展也引发了一些根本性的问题,即AI模型是否应该允许参与某些行为。模型是否应该根据图像来识别公众人物?是否应该从人的图像中推测出性别、种族或情绪?这些问题触及到隐私、公平性以及AI模型在社会中所允许发挥的角色等方面的众多已有和新颖问题。

总结来看,GPT-4V代表了人工智能领域的一大进步,提供了新的机遇,同时也带来了独特的挑战。在继续探索这个领域时,我们必须牢记,科技虽然能够开启新的大门,但我们有责任确保其道德和负责任的使用。