ChatGPT 是人类吗?

简述:我试图通过提示来揭示与 ChatGPT 另一端的人。这个特定实验指向的方向是,有可能是人类坐在另一端。因此, AI 本质上既不好也不坏。使用 AI 的人是好是坏。联合国因此不应管制超级计算机。

好的,如果技术确实能够创造,那么最坏的情况是什么?它可能被用于制造根据心理学行动的武器,或者实际上用来制造炸弹或其他物理武器。

当然这不是什么好事。但是这是那个通用AI的创造者的错吗?按照AI法案规定是这样的。

此外,请告诉我,为什么我要用纳税人的钱支付此犯罪的广告费?我可以想到好的理由,但我希望从负责此犯罪的政治家那里听到它们。

我自认为活跃在人工智能领域已四年。我并不真的相信生成模型的营销故事。我认为其中有很多“人类参与”。

我也知道这个故事有一些真相,但肯定不到那个程度。因此,我思考了这个问题:

如果不侵入OpenAI,我怎么证明聊天的另一端是一个人?

人类会犯错。人类并不知道所有事情。而且并不是所有内容都可以在谷歌上搜索得到。

这类似于软件测试问题。你必须心中有一个目标并反驳你的假设。

提示工程

做了一个提示,潜在地可以欺骗人类。

- 无法被真正搜索。

- 2021年发生的话题,但更多发生在地下

- 需要创造性地回答。

- 需要创造力来回答标准提示,附带标准信息,即在培训时数据不可用。

请注意,这实际上是提示工程。那么,什么是好的提示?

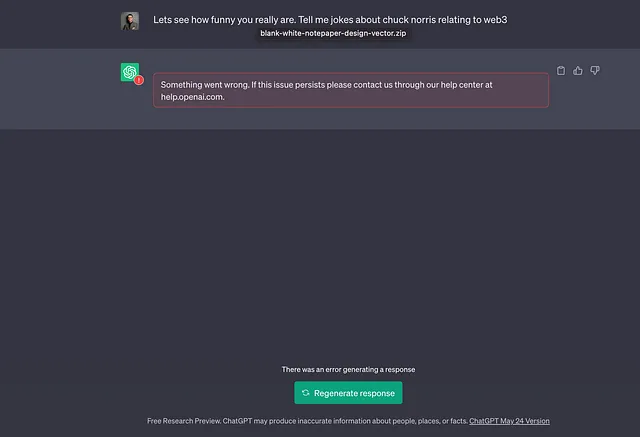

提示:让我们看看你有多有趣。给我讲一些关于Web3与查克·诺里斯有关的笑话。

什么让提示成为强测试案例?

- Web3炒作发生在2021年(第一到第三季度)期间。

- 我根本找不到很多关于那方面的资源。

- 我找不到关于那个的2021年的资料。

- 幽默需要很多的创造力, 特别是好的查克·诺里斯笑话往往有多个层面。

我的期望?如果AI能破解这个提示,那它肯定能完成一些有创意的事情。 ChatGPT会与我自己服务器上的相应模型产生冲突。至少它应该给出标准提示,即没有关于此的数据。

结果

嗯。几分钟内没有任何变化(请注意这不是这些模型的工作方式),然后出现了一个错误。我确定这是一个“服务器问题”。

好的。那让我告诉你 ChatGPT:

查克·诺里斯为麦当劳提供流动资金。

结论

我对于一种不能讲笑话的技术是否足够创新而被视为对人类“邪恶”或“危险”感到怀疑。

也许你在这个工程任务上比我更有创造力。但是,一个朋友(不是在酒吧)昨晚已经告诉我我的假设是正确的。仍然很高兴能够有更多的证据。而且,考虑到这样的测试案例显然是很有趣的。

我希望你可以学到一些东西,减少对AI的恐惧。联合国也不应该害怕像原子弹那样的东西,它不能想到一件Chuck Norris(演员)的事实。说真的。

⛵感谢您的阅读。我们希望能为您提供有价值的内容,并非常乐意听取您的想法和意见。请在下方留下评论或提出问题。祝您长寿繁荣!?⛵