ChatGPT的真实谎言

当我说“真谎言”时,我是指ChatGPT正在模糊真实和虚构(谎言)之间的界线。如果不是不可能,现在很难从它生成的文字中分辨出真假。这可能会导致一种困惑和不确定感,因为您不确定该相信什么。

ChatGPT撒谎吗?

好吧,我们已经知道ChatGPT说谎了 - 而且这也不是很罕见。实际上,它已经因说谎多次被指责,比如在这篇文章和这个例子中。关于收集电影、书籍等方面的信息,这可能并不重要。然而,ChatGPT向我提供了一些令人信服的虚假研究结果,这让我感到震惊。它们听起来非常可信,我几乎相信了它们…

用ChatGPT进行研究

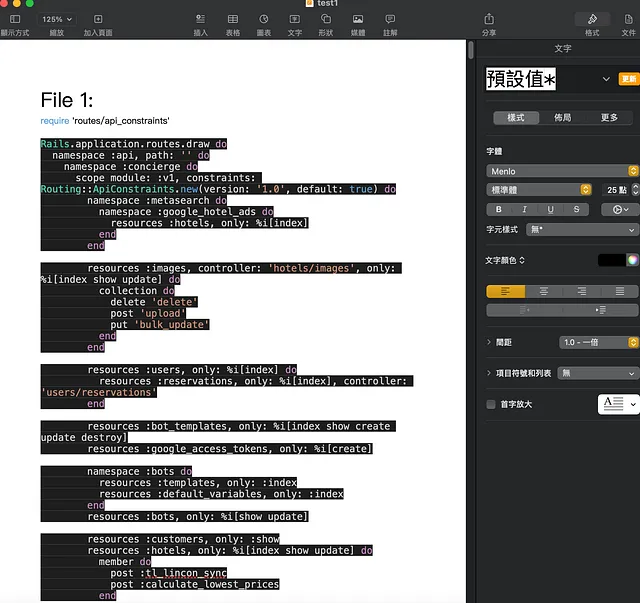

我使用了材料化视图和一些索引,使得对 PostgreSQL 数据库中的复杂查询提升了近70倍的性能。在相关的演示中,我正在寻找公开可用的研究,了解其他人如何通过使用材料化视图和索引来提高查询性能。谷歌搜索并没有给我很大的帮助,所以我决定向 ChatGPT 寻求帮助。

ChatGPT作为一名乐于助人的助手,向我提供了一些“实际”研究数据,显示了使用物化视图和索引所取得的令人印象深刻的结果。然而,令我失望的是,我发现所有这些研究实际上都是假的!

以下是我聊天记录的截图。看看它们看起来多么可信。我还在截图后包含了那些链接——尽管它们都不存在。 ¯\_(ツ)_/¯

提供示例链接的链接 –

- StackOverflow: https://stackoverflow.blog/2016/03/29/how-stack-overflow-builds-and-deploys-its-entire-app-stack/ StackOverflow:https://stackoverflow.blog/2016/03/29/how-stack-overflow-builds-and-deploys-its-entire-app-stack/

- AdRoll: https://www.postgresql.eu/events/pgconfeu2018/schedule/session/2103-building-a-scalable-real-time-ad-serving-platform-with-postgresql/ AdRoll: https://www.postgresql.eu/events/pgconfeu2018/schedule/session/2103-building-a-scalable-real-time-ad-serving-platform-with-postgresql/

- Zalando:https://www.postgresql.eu/events/fosdem2019/schedule/session/2391-building-a-data-warehouse-with-postgresql/

揭穿谎言

因此,我揭露了谎言,并再次要求ChatGPT为我提供更可靠的参考资料。

结果?自己检查。

提供第二组可靠示例的链接 –

- GitLab: https://about.gitlab.com/blog/2020/12/03/gitlab-data-team-reduce-10tb-of-data-to-10gb/ GitLab:https://about.gitlab.com/blog/2020/12/03/gitlab-data-team-reduce-10tb-of-data-to-10gb/

- TransferWise: https://databaseline.bitbucket.io/postgresql/2020/07/28/materialized-views-performance/ TransferWise:https://databaseline.bitbucket.io/postgresql/2020/07/28/materialized-views-performance/

- TimescaleDB: https://blog.timescale.com/blog/building-materialized-views-in-postgresql-for-fast-queries/ TimescaleDB:https://blog.timescale.com/blog/在postgresql中构建材料化视图,以实现快速查询/

你可以点击这些链接并检查它们是否真的存在。我甚至尝试搜索了一些关于这些现实生活中的例子的文本,但是谷歌(或者回溯机器)并不知道这些链接的任何事情。我没有更多要补充的了。

这些谎言的原因

大型语言模型(LLM)如ChatGPT仍在不断发展。许多重要的LLM行为是不可预测的。这种出现是LLM展示新的和意外的行为的能力,这些行为不是明确编程进它们的。在这个阶段,甚至专家(包括它们的创造者)也不完全了解LLM是如何工作的。此外,没有可靠的技术来引导LLM的行为。如果您对此真正感兴趣,请阅读由LLM专家Sam Bowman撰写的相关论文-了解大型语言模型的八件事。

因此像ChatGPT这样的LLMs不会故意撒谎,因为它们没有意识或意图。但它们偶尔可能会产生不正确或误导性的信息。这显然被列为ChatGPT的限制之一。

将ChatGPT视为一个非常有想象力的孩子,他可能会偶尔编造出令人信服的故事来回答您的问题。

结论

ChatGPT能生成你想要的文本,但验证和确认你收到的信息是你的责任。相信我,就是这样。 :P

啊?这是不是意味着ChatGPT真的没什么用?

不! 一点也不。

ChatGPT非常有用,当你需要想出不同的书写方式时。它很好地理解书写文本的语气(非正式、有趣、专业等),并帮助你转换到另一种语气。它可以解释复杂的概念,10岁儿童也容易理解,或向专业领域的专家提供高级细节。它可以概括大型文章或书籍。它甚至可以根据给定的指令生成诗歌、打油诗、电子邮件、信函等。明智地利用ChatGPT的优势。

生成式人工智能,无论是文字还是图片,每天都在变得越来越复杂。然而,现在比以往任何时候都更加关键的是,运用批判性思维来评估人工智能生成的内容的真实性。我可以证实这一点!

顺便提一下,这篇文章中使用的特色图像(谎言者ChatGPT / 木偶)是由DALL-E创建的,使用了ChatGPT本身生成的提示。这不酷吗?