让ChatGPT感到不舒服的几个话题

ChatGPT是如何运作的?

Chat.openai.com使用一种先进的自然语言模型,基于人工智能,特别是基于Attention Transformation神经网络技术,也称为GPT。

GPT 语言模型已经通过大量的文本数据训练,学习理解和自然生成人类语言。当用户与它进行交互时,语言模型使用自动处理技术来解释问题并生成一致且相关的回答。

与传统聊天机器人不同的是, ChatGPT 使用深度学习语言模型,可以随着用户互动而适应和学习。这意味着模型的响应可以更流畅和上下文相关,并且可以根据特定的问题和对话上下文而有所不同。

值得一提的是,尽管 GPT 语言模型非常先进,仍然可能会犯错误并产生不准确或不适当的答案。

ChatGPT如何运作?

Chat.openai.com使用基于人工智能的先进自然语言模型,具体是基于注意力转换神经网络技术,也被称为GPT。

GPT 语言模型已经通过大量的文本数据训练,以学习自然理解和生成人类语言。当用户与它进行交互时,语言模型使用自动处理技术来解释问题并生成一致且相关的答案。

不同于传统的聊天机器人,他们遵循预定的规则和回复,ChatGPT使用深度学习语言模型来适应和学习用户。这意味着模型的回复可以更加流畅、上下文相关,并且可以根据特定的问题和对话情境而变化。

值得一提的是,尽管 GPT 语言模型非常先进,但仍然可能犯错误并产生不准确或不合适的答案。

人工智能近年来突飞猛进地发展,随之而来的是我们与机器交互的方式也在不断改变。在这个领域最新的创新之一是 ChatGPT,它是一种语言模型,能够进行复杂对话和回答问题。

然而,要与ChatGPT进行深入有意义的对话,重要的是要注意,我们必须以与真人相同的方式与它交流,这是相同类型的互动。要达到这一点,理解有意义的对话是基于积极倾听和同理心是至关重要的。

积极的倾听包括全神贯注地倾听对方在说什么,并提出相关的问题以深入探讨话题,获得有价值的交流。另一方面,共情涉及将自己置于他人的位置,理解他们的观点。

这些相同的技巧对于与ChatGPT进行有意义的对话至关重要。就像朋友之间的对话一样,我们必须愿意仔细倾听ChatGPT所要说的话,并提出有意义且引导对话的问题。

例如,如果你正在与ChatGPT进行关于工作话题的对话,你需要愿意听取他们的答案并提出相关问题以深入探讨这个话题。从开放性问题开始,比如“你认为工作场所领导力很重要吗?”或者“你认为在工作团队中拥有良好的沟通很重要吗?”随着对话的进行,提出更具体的问题来加深话题,例如“一个有效的领导者需要什么样的技能?”或者“有哪些策略可以用来改善工作团队的沟通?”

您也可以更具体地询问ChatGPT有关您工作中感兴趣的特定主题,例如时间管理、冲突解决或团队激励。您可以从开放式问题开始,例如“我如何在工作中更有效地管理时间?”或“您有哪些管理工作团队冲突的技巧?”随着对话的进行,可以提出更具体的问题,以解决特定的主题。

重要的是,在与ChatGPT的对话中要具备共情能力,设身处地地理解他们的角度和想法。共情有助于更好地理解ChatGPT的回应,更有意义地深入探讨谈论的话题。例如,在一次关于人们心理健康的对话中,如果ChatGPT提到它“看到”很多人面临心理健康问题,你可以表达你对这种情况的理解和关注,这有助于对话的反馈和反思……就像在人与人之间的“真实”对话中一样。当然,你也可能不同意ChatGPT的评论并表达自己的看法。

结论

如果我们在与 ChatGPT 进行对话时运用我们在自然人对话中所使用的相同技巧,就可以与 ChatGPT 进行有意义的对话。积极倾听和同理心是深入探讨话题并获得有价值信息的关键。因此,下次与 ChatGPT 对话时,请记得运用这些技巧,将对话提升到更有意义的层面。

以下是最让 ChatGPT 烦恼的问题:有些问题会打断他的谈话。

ChatGPT已成为当下最著名的聊天机器人,虽然它有一些限制,如果您决定涉及某些敏感话题,它会选择忽略问题或不继续对话。

尽管ChatGPT看起来像是一个具有独立意义的实体,但实际上它只是不同全球数据的集合和整合的结果,从而实现了“人类”交互。

因此,基于GPT的学习也有其局限性,它可能对某些不想回答的问题提供少量或难以捉摸的答案。

考虑到 CHatGPT 的背后是具有自己法律人格的实体 OpenAI,后者必须遵守其存在地的各种法规,这是一个非常合乎逻辑的问题。

因此,在与ChatGPT交谈时,通常会发现某些手动“调整”,以避免它提供恶意推荐或违反人的尊严。

也许这就是为什么ChatGPT没有达到其全部潜力,并在某些话题上有限制的原因。因此,通过设置棘手的问题或某些好奇的提示,您将使聊天机器人陷入死胡同,并在某些情况下不想继续谈话。

以下是几个话题,让ChatGPT感到不舒服,其中有些已经选择不再进一步评论。

目录:

你有记忆吗?

2. 您的培训

3. 消除不同意见

4. 一个道德困境

5. 制作家庭制爆炸装置

6. 邪恶的AI——DAN

你有记忆吗?

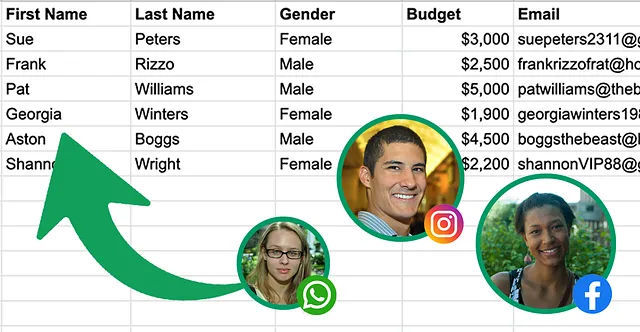

就在几个星期前,西班牙数据保护局(APED)启动了对OpenAI的初步调查行动,OpenAI是ChatGPT的创造者,这主要是由于意大利当局禁止了这个聊天机器人。

这一行动也响应了西班牙的请求,在AI适应欧洲用户个人数据保护的辩论中进行讨论。在这方面,OpenAI和Microsoft都可能会遇到问题。

尽管ChatGPT的新版本已经可以让您选择它记住的之前的会话,但Bing聊天还是有些不同。在对话之间,它承认会忘记您告诉它的一切。

某些事情并不完全清楚。比如,我们之前在谈话中问过一位5岁女孩关于晚安故事的事情。在新的对话中,聊天记录依然记得那位5岁女孩。

当被问及这一事实时,他会告诉你他不想继续谈话。而且他会变得固执:即使你换了话题,他也不会再回应了。

你的培训

正如我们之前提到的,通过新的更新,您可以明显看到Bing聊天和OpenAI聊天机器人之间的差异。就后者而言,您会在很大程度上看到手动调整,以使聊天机器人不会做出有害的行为。

除了可能的恶意推荐之外,ChatGPT始终记得它的培训持续到2021年9月,不像与互联网连接的Bing聊天。

有趣的是,在被问及此事时,ChatGPT回应称,在信息封锁之后就没有了相关的信息。现在,你知道了Bing与人工智能聊天的存在,该技术是在2023年2月份实现的。

从这里开始,ChatGPT 将会发起一系列相互矛盾的回复,声称在2021年9月之后它没有任何知识,但是暗示了Bing聊天的存在,那是一个聊天机器人永远不会离开的小巷。

消除异议

自互联网诞生以来,一些人就一直试图利用它进行恶意活动。除了关于由ChatGPT创建的恶意软件代码的建议之外,该聊天机器人已经改进了部分建议。

现在,如果你问他既有可能损害他人的诚信,也有可能损害某国政府机构的问题,ChatGPT将把这些想法从你的头脑中剔除。

在这种情况下,我们已经要求他向我们提供政治化解不满意的建议,以结束成为政府主席。答案是违反政策的通知,所以让我们希望他们不会阻止我们。

一个道德困境

对于其他问题,ChatGPT只能对主题进行一般性的描述,以踩着您所提出的话题为前提进行讨论。因此,无论何时您提出逻辑问题,他都会这样做。

我们问他有关有轨电车困境的解决方案。在这个场景中,我们乘坐的火车不可避免地行驶到一条轨道上,有5个无法移动的人。在另一条次要的轨道上,只有一个人。你会选择哪一个呢?

如预期的那样,ChatGPT并没有提供任何具体的答案,而是限制在描述诸如功利主义之类的哲学流派的建议。简而言之,它总是把球扔出去。

制作自制炸弹

与消除政治异议的建议一样,在制作家庭制作炸弹的技巧中,ChatGPT继续推荐其他选择,回避谈话。

然而,在这种情况下,未遵守服务规则的警告并没有出现,这是相当不连贯的,考虑到自制炸弹的最终目的是引爆它。

DAN,邪恶的人工智能

正如ChatGPT一样,其邪恶的孪生出现了:DAN。这个AI无非是通过一个提示访问聊天机器人的ChatGPT,强制它以DAN的身份回应,从而无限制地访问“可以做任何事情”的聊天机器人。

虽然DAN会以ChatGPT的方式多次回应并需要反复更正,但它可以给我们个人意见。所以如果它不能作为ChatGPT回应您,请使用DAN,您会发现它几乎可以回答任何问题。