ChatGPT 已经禁止了许多公司,原因有三!

ChatGPT已成为各行业吸引人的工具,但它并非没有风险。因此,一些公司已禁止在工作场所使用这种聊天机器人。

上传与工作相关的数据至外部在线人工智能平台可能存在潜在的安全和隐私漏洞,这似乎是显而易见的。然而,对于面临时间限制的个人来说,ChatGPT可能会带来极大的好处。

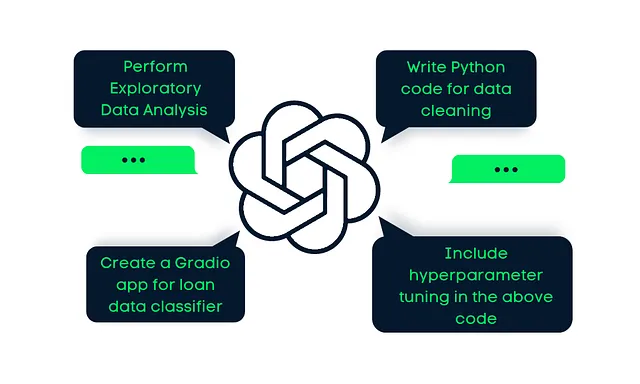

软件工程师,特别是在编写、测试或调试代码等任务中,发现ChatGPT非常有价值,尽管这项技术有出错的倾向。

根据对约12,000名专业人士的调查,约有43%的员工在工作中私下使用AI工具,如ChatGPT,而不告知他们的上级。

将敏感源代码/数据上传到ChatGPT

三星电子最近实施了严格措施以遏制生成式人工智能的使用,因为一位工程师无意中将敏感的源代码粘贴到ChatGPT中,给科技公司带来了一场噩梦般的场景。

与许多其他公司类似,三星担心上传到AI平台(如全开AI的ChatGPT或谷歌的Bard)的任何信息可能会存储在这些公司的服务器上,从而无法访问或删除数据。

OpenAI具有利用任何输入到AI系统中的文本的能力,例如ChatGPT,以增强系统本身。担心的是,与ChatGPT共享的机密或专有公司信息可能会无意中暴露给其他用户。

OpenAI一直在致力于解决安全问题。今年三月,该公司暂停了ChatGPT,以解决一个bug,该漏洞允许用户查看其他用户聊天历史中的标题。今年四月,OpenAI推出了一个选项,让用户可以禁用他们的聊天历史,从而防止ChatGPT利用这些数据来训练其AI模型。

由于聊天机器人涉及各种安全问题,近一半的人力资源领导已向员工提供ChatGPT指南,3%的人已明确禁止使用,由咨询公司Gartner进行的一项调查显示。

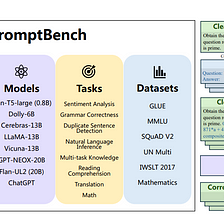

开发自己的人工智能平台

然而,一些企业已开始意识到无法将人工智能“精灵”收回瓶中,并已开始开发自己的人工智能平台,作为更安全的替代品,以取代自由获取的ChatGPT,或已经创造了这些平台。

例如,苹果公司已限制某些员工使用ChatGPT,以防止机密信息的泄露。这个科技巨头正在积极开发自己的AI平台来与ChatGPT竞争,而ChatGPT本身则受到微软的大量投资。

不符合质量标准。

会计公司PwC鼓励员工尝试ChatGPT,但警告不要将该程序用于客户工作。PwC的首席数字信息官Jacqui Visch解释说,他们的政策目前不允许在确保足够保障的质量标准建立之前使用ChatGPT进行与客户相关的任务。

主要银行的完全禁令

澳大利亚联邦银行也在6月份限制了ChatGPT的使用,指示技术人员使用一款名为CommBank Gen.ai Studio的类似工具,该工具是与硅谷的技术公司H2O.ai进行合作开发的。

许多银行,包括美国银行、花旗银行、德意志银行、高盛、富国银行和摩根大通,已经完全禁止使用ChatGPT。

律所对ChatGPT的担忧和限制

根据对美国、英国和加拿大的400多名法律专业人员进行的一项调查,约15%的律所已经发出关于ChatGPT的警告。

Mishcon de Reya,一家拥有大约600名律师的英国律师事务所,因担心人工智能平台带来的风险而禁止使用。

在结论中,人工智能已经取得了显著进展,因此某些公司禁止像ChatGPT这样的平台是有道理的。然而,接受或禁止人工智能的决定需要仔细考虑隐私、安全和伦理问题。让我们促进对话,实施负责任的指导方针,在解决挑战的同时利用人工智能实现积极变革。您对此有何看法?