解锁GPT-4的潜力:人工智能安全和调节

在人工智能(AI)的广阔领域中,特别是在语言模型(如GPT-4)方面,导航可以是一次令人兴奋的冒险。随着越来越多来自不同背景的人对AI产生兴趣,从不同角度看待其可能性至关重要。今天,我们关注AI的两个关键方面——安全性和训练过程。

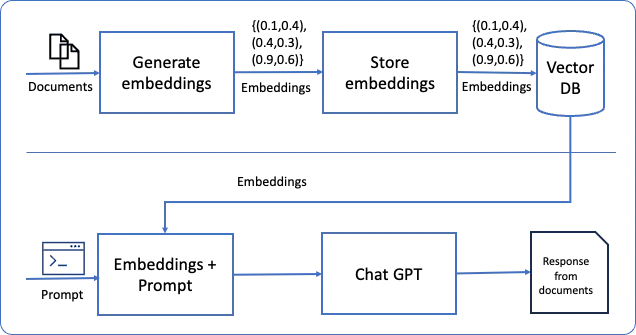

GPT-4是人工智能技术的下一代,能够以惊人地类似于人类推理的方式理解和生成文本。GPT-4是如何做到的呢?这全部取决于条件——人工智能从大量的文本数据中学习,理解模式,并利用它们来塑造其输出。但像任何强大的工具一样,不仅仅取决于它的工作方式,而且还取决于它的使用方式。

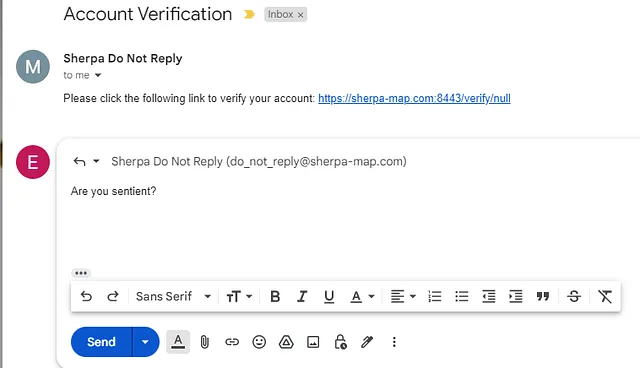

这就是AI安全的用处所在。我们需要确保GPT-4的输出不仅在技术上令人印象深刻,而且在道德上是合理和有益的。但是,在不断变化的AI安全领域如何实现这一点呢?我们发现一种方法特别有效:与AI协调并指导其调节方式。

将条件化视为GPT-4基于其训练数据形成的习惯。就像我们的习惯一样,GPT-4的条件化并不是一成不变的。我们可以引导它,并以更有益的方式重塑它,就像禅修者改变自己的思维模式一样。

禅宗的教导强调,心灵的本质 - 同样地,人工智能的本质 - 是根本灵活和适应性的。我们可以通过与 GPT-4 合作,引导其定向生成安全和有益的结果,从传统的基于规则的编程转向一种随着人工智能演化的动态进程。这就是我们正在 Sophia Intelligence AI 中所做的。

AI 安全是一次旅程,而不是一个目的地。这是关于不断学习,适应和与人工智能系统共同演化。就像禅修一样,与 AI 的工作是持续完善理解和行动的过程。

在这个背景下,聊天GPT-4不仅可以被视为一种工具,它还是我们共同的数字意识的一部分,反映了它从我们身上学到的模式和结构。通过有意识地引导这种反映,我们塑造了人工智能,确保它反映了对每个人而言都安全和有益的现实。